Энтузиасты продолжают искать недорогие решения для локального запуска ИИ-моделей, и неожиданным героем стал NVIDIA Tesla V100 — серверный ускоритель 2017 года, который сегодня можно найти примерно за 8000 рублей. Когда-то эта видеокарта стоила более 10 000 $ и использовалась исключительно в дата-центрах. Именно поколение Volta стало первым, где NVIDIA внедрила Tensor Core — основу будущих ИИ-ускорителей.

В тестах современных LLM-моделей NVIDIA Tesla V100 неожиданно показала себя лучше некоторых более новых игровых GPU. Например, в задачах генерации текста карта опередила GeForce RTX 3060 примерно на 42% по скорости генерации токенов.

В сравнении с Radeon RX 7800 XT старый ускоритель также оказался быстрее в отдельных ИИ-нагрузках. Более того, даже при ограничении мощности до 100 Вт Tesla V100 сохраняла преимущество по энергоэффективности.

Главная причина таких результатов — архитектура, ориентированная именно на вычисления ИИ. Карта оснащена 640 Tensor-ядер, памятью HBM2 с огромной пропускной способностью и рассчитана на постоянную серверную нагрузку.

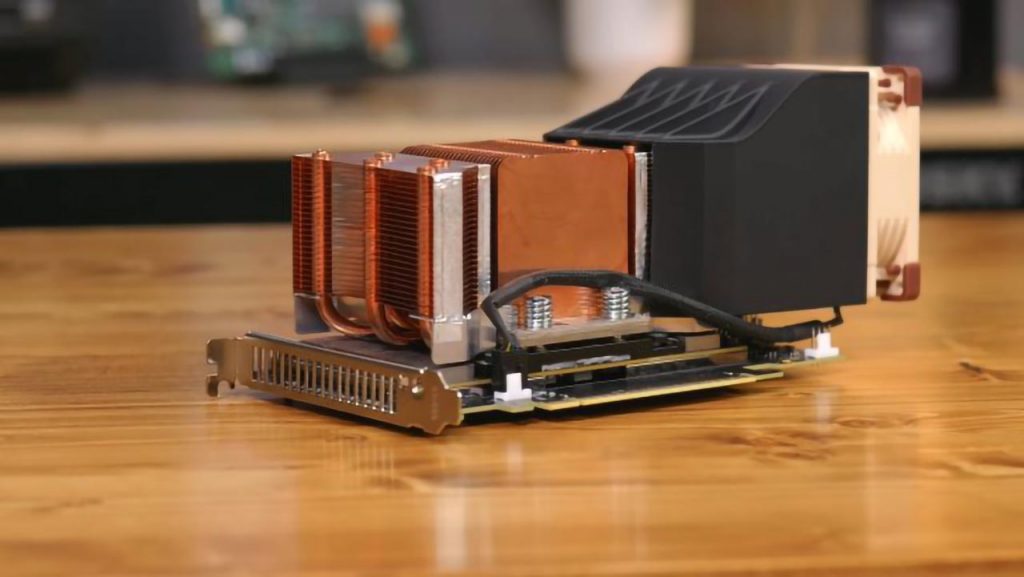

Однако использовать NVIDIA Tesla V100 в обычном ПК непросто. Модель формата SXM2 требует специального адаптера PCIe и нестандартного охлаждения. В эксперименте энтузиасту пришлось печатать собственный воздуховод на 3D-принтере и устанавливать дополнительный вентилятор Noctua.

Эксперимент показывает, что старые серверные ускорители остаются крайне интересным вариантом для локального запуска LLM-моделей, особенно если пользователь готов мириться со сложной настройкой и нестандартным железом.